数据中心gpu

NVIDIA A40 GPU 可使数据中心的性能和多工作负载能力获得进化式飞跃。它集优秀的专业图形性能与强大的计算和 AI 加速能力于一体,可应对当今的设计、创意和科学挑战。NVIDIA A40 能驱动新一代虚拟工作站和基于服务器的工作负载,并随时随地为专业人士提供光线追踪渲染、模拟、虚拟制作等领域的先进功能。

立即咨询

借助 NVIDIA A30 Tensor Core GPU 为各种企业工作负载带来加速性能。借助 NVIDIA Ampere 架构 Tensor Core 和多实例 GPU (MIG),它可以安全加速各种工作负载,其中包括大规模 AI 推理和高性能计算 (HPC) 应用程序。具有 PCIe 外形规格(非常适合主流服务器)的 A30 集快速显存带宽与低功耗于一体,不仅能实现弹性数据中心,还能为企业带来更大价值。

立即咨询

运用 NVIDIA A16 将远程工作提升至新境界。它结合了 NVIDIA 虚拟 PC (vPC) 或 NVIDIA RTX 虚拟工作站 (vWS) 软件,使虚拟桌面和工作站具有强大的功能和性能,可以随时随地处理各种项目。A16 专为高密度、图形丰富的虚拟桌面基础架构 (VDI) 所打造,并采用 NVIDIA Ampere 架构,可提供比前一代高两倍的用户密度,同时还能确保提供出色的使用者体验。

立即咨询

NVIDIA A10 GPU 为设计师、工程师、艺术家和科学家提供克服现今挑战所需的效能。小型的单插槽 150W GPU 与 NVIDIA 虚拟化 GPU (vGPU) 软件, 结合使用时,可在易于管理、安全且有弹性,能依照各种需求进行调整的基础架构中,加速多个数据中心工作负载,范围涵盖绘图丰富的虚拟桌面基础架构 (VDI) 以及人工智能。

立即咨询

NVIDIA A2 Tensor Core GPU 具有低功耗、小尺寸和高性能的特点,可为在边缘部署 NVIDIA AI 的智能视频分析 (IVA) 提供入门级推理功能。该 GPU 采用半高 PCIe 4.0 卡的设计,并提供 40-60 瓦的低热设计功耗 (TDP) 配置功能,能为大规模部署中的不同服务器带来通用的推理加速能力。

NVIDIA A100 Tensor Core GPU 可针对 AI、数据分析和 HPC 应用场景,在不同规模下实现出色的加速,有效助力更高性能的弹性数据中心。A100 采用 NVIDIA Ampere 架构,是 NVIDIA 数据中心平台的引擎。A100 的性能比上一代产品提升高达 20 倍,并可划分为七个 GPU 实例,以根据变化的需求进行动态调整。A100 提供 40GB 和 80GB 显存两种版本,A100 80GB 将 GPU 显存增加了一倍,并提供超快速的显存带宽(每秒超过 2 万亿字节 [TB/s]),可处理超大型模型和数据集。

NVIDIA L40S GPU 可为您提供突破性的多工作负载性能体验。 精心设计的 L40S GPU 将强大的 AI 计算性能与出色的图形和媒体加速功能相结合,旨在为新一代数据中心工作负载提供支持。从生成式 AI 和大型语言模型(LLM)推理与训练,到 3D 图形、渲染和视频,都能应对自如。

立即咨询

NVIDIA L4 Tensor Core GPU 基于 NVIDIA Ada Lovelace 架构构建,采用低外形尺寸封装的 L4 GPU 是一款经济高效的解决方案,可在从边缘、数据中心到云端的每台服务器中实现高吞吐量和低延迟。

立即咨询

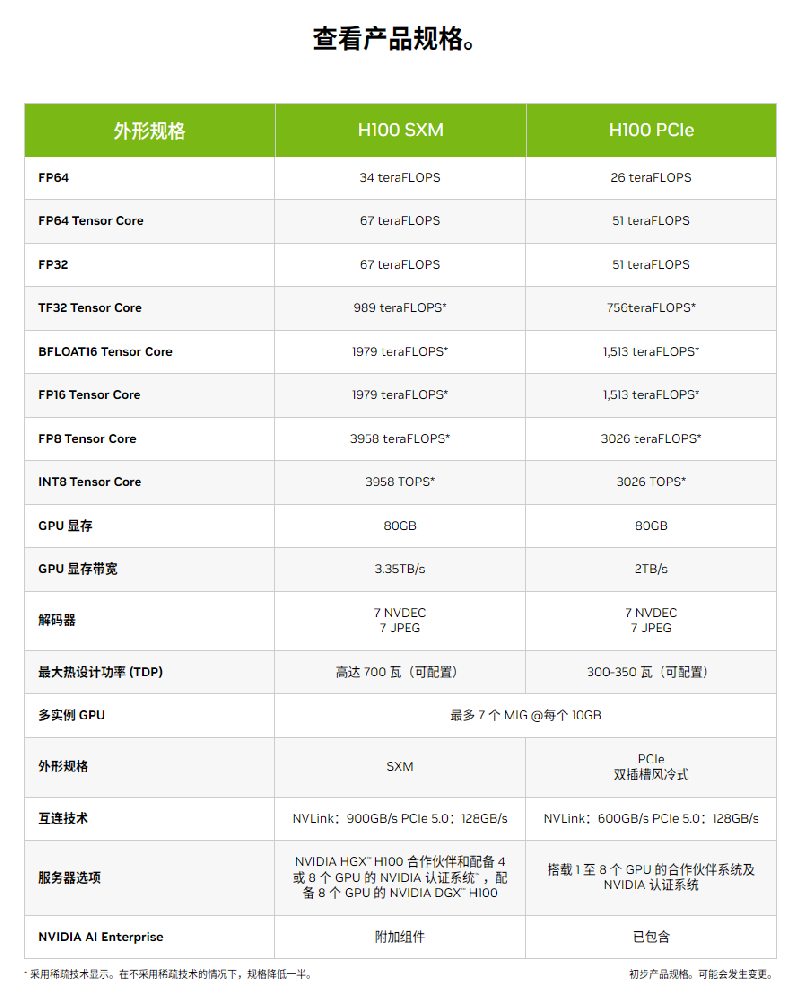

通过 NVIDIA H100 Tensor Core GPU,在每个工作负载中实现出色性能、可扩展性和安全性。使用 NVIDIA® NVLink® Switch 系统,可连接多达 256 个 H100 来加速百亿亿级 (Exascale) 工作负载,另外可通过专用的 Transformer 引擎来处理万亿参数语言模型。与上一代产品相比,H100 的综合技术创新可以将大型语言模型的速度提高 30 倍,从而提供业界领先的对话式 AI。